Salesforce уволила 4000 сотрудников ради AI и пожалела: Полное расследование ошибок

Контекст: Почему 4000 специалистов Salesforce лишились работы?

История Salesforce стала одним из самых громких кейсов 2025 года в индустрии технологий. Компания приняла решение сократить около 4000 позиций, сделав ставку на новую стратегию автоматизации. Руководство открыто заявило о переходе к использованию «агентного AI» (agentic AI) — систем, способных самостоятельно выполнять задачи, которые ранее требовали участия человека.

Изначально этот шаг подавался как победа эффективности. Генеральный директор Марк Бениофф и топ-менеджмент были уверены, что Salesforce AI достиг того уровня зрелости, когда алгоритмы могут взять на себя значительную часть операционной нагрузки. Речь шла не просто о чат-ботах, а о полноценных цифровых агентах, способных обрабатывать запросы, вести коммуникацию и решать технические проблемы.

Однако спустя несколько месяцев тон заявлений изменился. Внутренние дискуссии и публичные выступления руководства показали, что компания переоценила готовность технологий к реальному миру.

- Руководители признали «излишнюю самоуверенность» в возможностях AI.

- Технология отлично показывала себя в контролируемых демо-версиях, но буксовала в «полевых» условиях.

- Марк Бениофф, ранее выступавший евангелистом полной автоматизации, смягчил риторику, признав критическую роль человеческого фактора.

Давайте разберёмся, где именно пролегла граница между возможностями алгоритмов и реальностью, с которой столкнулся бизнес. ↓

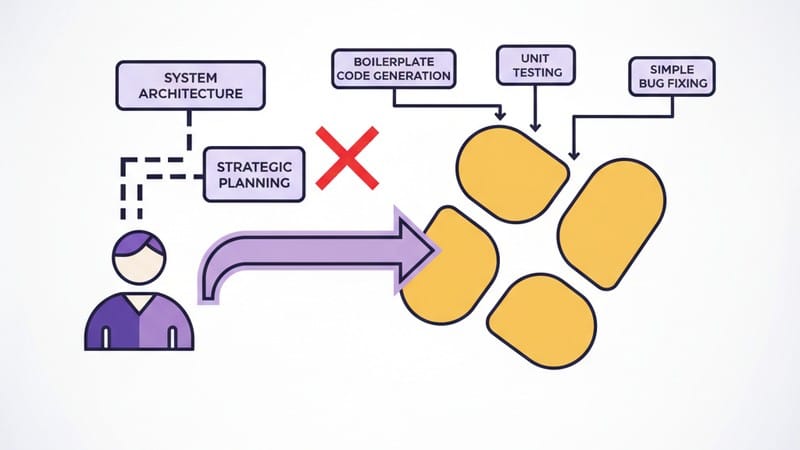

Технологическая ловушка: Какую роль разработчиков пытались отдать AI?

Основная ошибка заключалась в предположении, что автоматизация разработки и технической поддержки — это линейный процесс. В Salesforce рассчитывали, что AI сможет обрабатывать не только типовые запросы (например, сброс пароля), но и сложные сценарии, требующие анализа контекста.

На практике выяснилось, что Generative AI отлично справляется с задачами, у которых есть четкий алгоритм решения, но теряется там, где возникают нюансы.

Проблема «длинного хвоста» (Long-tail issues)

В разработке и поддержке существует понятие «длинного хвоста» — это редкие, нестандартные проблемы, которые составляют меньшую часть по количеству, но требуют большей части времени и экспертизы для решения.

AI-модели обучаются на массивах стандартных данных. Когда система сталкивается с уникальным багом или нестандартной конфигурацией среды клиента, она пытается применить шаблонное решение.

Пример того, как это выглядит в коде/скриптах:

# Ожидание от AI:

# Скрипт должен очистить кеш только для конкретного микросервиса пользователя

rm -rf /var/cache/servicename/userid/

# Реальность (галлюцинация или ошибка контекста):

# AI может не учесть специфику прав доступа или зависимостей

rm -rf /var/cache/servicename/

# Результат: удаление данных всех пользователей

В Salesforce столкнулись с тем, что агенты AI не могли корректно эскалировать проблемы. Вместо того чтобы передать сложный кейс человеку, бот пытался решить его самостоятельно, заходя в тупик или предоставляя неверную информацию.

Это создало ситуацию, при которой оставшиеся сотрудники были вынуждены заниматься «тушением пожаров», исправляя последствия неудачных автоматических решений, вместо того чтобы заниматься развитием продукта.

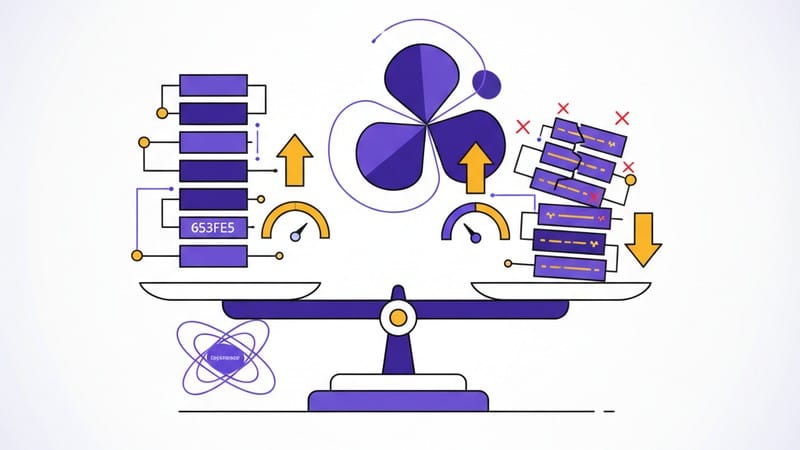

Сравнение эффективности: Опыт vs. Генеративный AI. Кто победил?

Ситуация с увольнениями в IT ради внедрения искусственного интеллекта часто базируется на простой метрике: скорость реакции. AI действительно отвечает мгновенно. Однако в профессиональной среде важна не только скорость ответа, но и его качество (Resolution Rate).

Давайте сравним, как подходят к решению задач опытный специалист и Generative AI.

1. Понимание контекста

- Специалист: Анализирует историю проекта, предыдущие тикеты, особенности архитектуры конкретного клиента и неявные зависимости.

- AI: Работает в рамках текущего контекстного окна. Если информация не была явно подана в промпте, она не будет учтена.

2. Работа с неопределенностью

- Специалист: Задаст уточняющие вопросы, если задача поставлена некорректно.

- AI: Попытается дать наиболее вероятный ответ на некорректный вопрос, что часто приводит к генерации нерабочего кода или ложных инструкций.

3. Ответственность за результат

В ходе внедрения выяснилось, что AI-агенты могут успешно закрыть 50% простых диалогов, но оставшиеся 50% превращаются в проблему.

Пример из практики разработки:

// Задача: Оптимизировать функцию сортировки массива объектов

// Решение AI (частое):

// Предлагает стандартный .sort(), не учитывая,

// что массив может содержать миллионы записей и вызовет блокировку потока.

const sortedData = bigDataArray.sort((a, b) => a.value - b.value);

// Решение инженера:

// Понимает объем данных и предлагает использовать

// базу данных для сортировки или стриминг.

Как видите, AI в разработке — это мощный усилитель, но плохой заменитель архитектурного мышления. Salesforce признали, что убрали людей именно с тех позиций, где требовалось суждение и экспертиза, а не просто процессинг данных.

Скрытые риски: Проблемы безопасности и интеграции AI-кода

Массовая замена квалифицированного персонала на алгоритмы вскрыла пласт проблем, связанных с безопасностью и качеством интеграции. Когда Salesforce AI начал брать на себя больше задач, возникли риски, которые не были очевидны на этапе планирования.

«Черный ящик» решений

Когда код или решение проблемы генерирует человек, он может объяснить логику своих действий (code review, документация). Когда решение генерирует нейросеть, логика часто остается непрозрачной.

Если AI внедряет фикс или меняет конфигурацию, отследить цепочку принятия решений становится сложнее. Это критично для Enterprise-сегмента, где важен аудит каждого действия.

Уязвимости в сгенерированном коде

Исследования показывают, что код, написанный AI, часто содержит уязвимости, если его не проверяет опытный разработчик.

- Hardcoded secrets: AI может случайно предложить вставить API-ключи прямо в тело скрипта.

- Устаревшие библиотеки: Модели обучаются на данных, которые могут отставать от актуальных версий безопасности на год и более.

Пример потенциальной уязвимости:

# AI может предложить использование небезопасной функции для десериализации

import pickledata = pickle.loads(userinput) # RCE уязвимость

Без должного надзора со стороны Senior-разработчиков или инженеров безопасности, такие решения могут попасть в продакшн. В Salesforce осознали, что сокращение штата привело к нехватке именно тех людей, которые должны валидировать работу AI.

Навыки, которые AI не заменит: Архитектура, Soft Skills, управление

Опыт Salesforce подтверждает тезис: AI в разработке меняет требования к специалистам, но не обнуляет их. Напротив, ценность определенных навыков резко возрастает.

Руководство компании в своих интервью отметило, что технологии не смогли заменить «человеческое суждение» (human judgment). Выделим три ключевые области, где AI проиграл.

1. Архитектурное видение

AI отлично пишет функции, но плохо проектирует системы. Он не может предвидеть, как изменение в одном модуле повлияет на масштабируемость системы через два года. Способность видеть «большую картинку» остается прерогативой человека.

2. Управление доверием (Trust & Relationship)

В B2B-секторе, где работает Salesforce, отношения строятся на доверии. Когда у крупного клиента падает продакшн, ему нужно не мгновенное шаблонное сообщение от бота, а уверенность, что конкретный инженер взял ситуацию под контроль. Эмпатия и умение успокоить клиента — это Soft Skills, которые невозможно автоматизировать.

3. Разрешение конфликтов и переговоры

Разработка — это не только код, это согласование требований.

- Почему эту фичу нельзя делать так, как хочет заказчик?

- Какие компромиссы допустимы?

AI не умеет вести переговоры и отстаивать технические решения.

Экономика провала: Когда кажущаяся экономия на деле стоит дороже

Решение об увольнении 4000 сотрудников было продиктовано желанием сократить расходы (OPEX) и повысить маржинальность за счет технологий. Однако экономическая модель, которая выглядела красиво в Excel, столкнулась с реальностью.

Скрытые издержки внедрения

Вместо прямой экономии компания получила новые статьи расходов:

- Затраты на исправление ошибок: Время, потраченное оставшимися сеньорами на дебаг решений AI, стоит дороже, чем время джуниоров, которых сократили.

- Реорганизация процессов: Компании пришлось в экстренном порядке перераспределять нагрузку и возвращать людей в контуры, где AI не справился.

- Потеря институциональной памяти: Уволенные сотрудники унесли с собой знания о специфике систем, которые не были задокументированы. AI не может обучиться на знаниях, которых нет в датасете.

Марк Бениофф, комментируя ситуацию, отметил, что компания была вынуждена «перебалансировать» ресурсы. Это эвфемизм, означающий, что ставку на полную автономность пришлось отменить.

Generative AI — это инструмент повышения производительности (copilot), а не полной замены сотрудника (autopilot). Попытка сэкономить на фонде оплаты труда привела к операционным разрывам, устранение которых теперь требует дополнительных инвестиций.

Заключение

История Salesforce — это важный урок для всей IT-индустрии. Она наглядно показывает, что автоматизация разработки и сервиса имеет свои пределы.

Выводы для разработчиков и технических лидеров:

- AI — это инструмент, а не сотрудник. Используйте его для ускорения рутины, но не доверяйте ему критические решения без валидации.

- Развивайте T-shaped навыки. Умение писать код становится базой, но умение проектировать системы, понимать бизнес-контекст и коммуницировать делает вас незаменимым.

- Не бойтесь увольнений, бойтесь стагнации. Те, кто учится управлять AI, будут востребованы. Те, кто игнорирует AI или, наоборот, слепо полагается на него, рискуют оказаться в зоне риска.

Технологии развиваются стремительно, но, как показал опыт Salesforce, «человека в контуре» (human in the loop) убирать пока слишком рано.